Los desarrolladores ya pueden integrar los modelos ChatGPT y Whisper de OpenAI LLC en su software gracias a las nuevas interfaces de programación de aplicaciones que ya están disponibles.

Una interfaz de programación de aplicaciones, o API, es un canal a través del cual los programas intercambian datos e instrucciones entre sí. Permite que una aplicación haga que otra carga de trabajo realice una tarea cuando se cumplen determinadas condiciones. Una aplicación de marketing, por ejemplo, puede pedir a una herramienta de inteligencia artificial que traduzca el texto de un anuncio a otro idioma.

La primera API nueva que OpenAI ha presentado es la de su modelo ChatGPT. Hasta ahora, ChatGPT era accesible principalmente a través de una interfaz gráfica, lo que significa que los desarrolladores no tenían una forma sencilla de conectarlo a sus aplicaciones. La nueva API, ya liberada, elimina esa limitación.

Desde que ChatGPT debutó el pasado diciembre, los investigadores de OpenAI han realizado optimizaciones que permiten a la red neuronal funcionar utilizando menos hardware. El resultado es una reducción significativa de los costos. La API de ChatGPT estará disponible a un precio 10 veces inferior al de la API del anterior modelo GPT-3.5 de OpenAI, según ha detallado la startup.

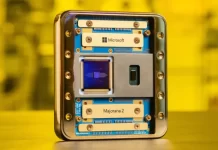

OpenAI aloja ChatGPT en la nube pública Azure de Microsoft Corp. en una infraestructura multiusuario. Esto significa que las implementaciones de varios usuarios se ejecutan en el mismo hardware. Para los clientes con requisitos avanzados, OpenAI añade la posibilidad de desplegar su nueva API ChatGPT en una infraestructura dedicada no compartida con otros usuarios.

El uso de infraestructura dedicada permite a los clientes personalizar la configuración de la API ChatGPT en mayor medida de lo que sería posible de otro modo. Una empresa podría, por ejemplo, compensar parte de la velocidad de generación de respuestas por el rendimiento o viceversa si una aplicación así lo requiere. Además, según OpenAI, la opción de alojamiento dedicado permite a los desarrolladores optimizar el rendimiento de sus despliegues ChatGPT de forma más precisa.

«La familia de modelos ChatGPT que lanzamos, gpt-3.5-turbo, es el mismo modelo utilizado en el producto ChatGPT», escribieron los ejecutivos e investigadores de OpenAI en una entrada de blog. «Su precio es de 0,002 dólares por 1.000 tokens, 10 veces más barato que nuestros modelos GPT-3.5 existentes. También es nuestro mejor modelo para muchos casos de uso que no son de chat.»

La segunda API que OpenAI se ha presentado permitirá a los desarrolladores acceder a una versión gestionada del modelo de transcripción Whisper de la startup.

El modelo, que se detalló por primera vez el pasado septiembre, está disponible bajo una licencia de código abierto. Como resultado, las empresas pueden, en teoría, crear una implementación interna de Whisper en lugar de utilizar la API de OpenAI. Pero según la empresa, Whisper es técnicamente difícil de implantar manualmente, una barrera de adopción que la API aborda.

Permite a los desarrolladores implementar funciones de transcripción automática de una de las maneras siguientes. Whisper puede transcribir palabras habladas en su idioma original o traducirlas al inglés. La versión original de Whisper, que debutó el año pasado, se entrenó con 680.000 horas de audio procedentes de la web, de las que aproximadamente un tercio no eran en inglés.

«Ahora hemos puesto a disposición el modelo large-v2 a través de nuestra API, que ofrece un cómodo acceso bajo demanda a un precio de 0,006 $/minuto», explica el personal de OpenAI en la entrada del blog de hoy. «Además, nuestra pila de servicios altamente optimizada garantiza un rendimiento más rápido en comparación con otros servicios».

OpenAI está desplegando sus dos nuevas API de aprendizaje automático junto con una actualización de sus condiciones de servicio. La startup ya no utilizará los datos enviados a sus modelos con fines de entrenamiento de IA a menos que los clientes lo autoricen. Además, la empresa está simplificando el texto de sus condiciones de servicio y mejorando la documentación para desarrolladores de sus productos.

Fuente WEB | Editado por CambioDigital OnLine