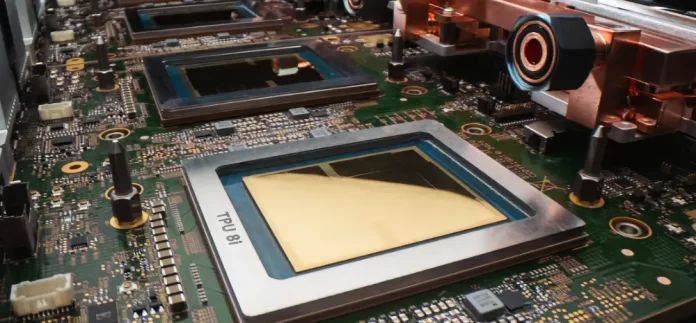

Google ha presentado la octava generación de sus Tensor Processing Units, una familia de aceleradores diseñada para una etapa en la que los sistemas de IA funcionan como agentes capaces de planificar, coordinar tareas y operar de forma continua. La compañía introduce dos variantes —TPU 8t y TPU 8i— con el objetivo de cubrir necesidades distintas en entrenamiento e inferencia, un enfoque que refleja cómo han evolucionado los modelos de gran escala y las cargas de trabajo distribuidas.

TPU 8t se orienta al entrenamiento de modelos avanzados, con una arquitectura que permite integrar miles de chips en un mismo superpod y trabajar sobre un espacio de memoria compartido de varios petabytes. Google destaca que esta capacidad reduce la fragmentación y los cuellos de botella habituales en sistemas distribuidos. La plataforma incorpora telemetría en tiempo real, mecanismos automáticos de resiliencia y una red óptica reconfigurable, elementos pensados para mantener la estabilidad en entrenamientos prolongados.

TPU 8i, en cambio, se centra en la inferencia y en escenarios donde la latencia es determinante, especialmente en aplicaciones con múltiples agentes interactuando. Para ello, Google ha ampliado la memoria en chip, rediseñado la interconexión con una topología que acorta la distancia efectiva entre nodos y añadido un motor dedicado a operaciones colectivas. Estas mejoras buscan servir modelos complejos con mayor eficiencia económica en un momento en el que la demanda de inferencia crece con rapidez.

Ambas arquitecturas se integran con Axion, el procesador Arm personalizado de Google, lo que permite optimizar el sistema completo desde el host hasta el acelerador. La compañía mantiene su apuesta por un ecosistema abierto, con compatibilidad nativa con JAX, PyTorch, MaxText, SGLang y vLLM, además de herramientas que facilitan el paso del prototipo al despliegue. Este enfoque responde a un mercado cada vez más competitivo, donde surgen alternativas basadas en RISC-V y diseños especializados para modelos de mezcla de expertos.

Google también subraya el papel de la eficiencia energética. La empresa afirma haber multiplicado por seis la capacidad de cómputo por unidad de electricidad en cinco años, gracias a mejoras en refrigeración líquida, redes y software. TPU 8t y 8i continúan esta línea con un diseño que reduce el coste energético del movimiento de datos, un factor crítico en infraestructuras de gran escala.

La compañía sitúa esta generación dentro de su concepto de AI Hypercomputer, una plataforma que combina hardware especializado, software abierto y modelos de consumo flexibles. Según Google, los agentes autónomos requieren infraestructuras que minimicen la latencia, maximicen la disponibilidad y escalen sin rediseños profundos. Las nuevas TPUs estarán disponibles de forma generalizada a finales de año y se presentan como un paso hacia sistemas más cohesionados y preparados para flujos de trabajo continuos.

Fuente: Blog Google Cloud | Editado por CDOL