Según el más reciente análisis de la firma de consultoría Omdia, el crecimiento de los modelos de IA de frontera más grandes ha experimentado una desaceleración drástica, mientras que los modelos pequeños y medianos están expandiendo rápidamente sus capacidades y su adopción en la industria.

El informe AI Model Trends Spring 2026: State of the Art AI Models and their Compute Demands revela que el crecimiento de parámetros en los modelos de vanguardia solo ha aumentado un 5% anual desde 2021. Esta cifra contrasta radicalmente con el periodo entre 2019 y 2021, cuando la expansión superó un factor de 100. Al mismo tiempo, la definición de modelos pequeños está cambiando: las versiones de entre 7.000 y 14.000 millones de parámetros están desplazando a los modelos de clase de 100 millones, mientras surge una categoría de código abierto de tamaño medio que gana terreno en desarrollo y sentimiento del mercado.

El fin de la carrera por el tamaño

Alexander Harrowell, analista principal senior de computación avanzada en Omdia, explica que este cambio no se debe a una crisis en el sector. En años anteriores, los frenos prolongados en el crecimiento de modelos se asociaban con inviernos de la IA, pero hoy el motor del cambio es distinto.

Creemos que mucho de esto está vinculado al auge de los agentes, señaló Harrowell. Los sistemas de IA modernos derivan su rendimiento del uso de herramientas, intercambiando efectivamente computación de CPU, relativamente económica, por recursos de GPU más costosos. Como resultado, es probable que la relación CPU:GPU se acerque al 1:1.

Agentes y ventanas de contexto: los nuevos desafíos

La proliferación de agentes está impulsando la demanda de ventanas de contexto cada vez más extensas. Debido a que todas las entradas, interacciones y comunicaciones de herramientas pasan por esta ventana, la capacidad de contexto extendido se ha vuelto crítica.

Esto está dando lugar a una nueva jerarquía de caché que abarca memoria y almacenamiento rápido para gestionar la descarga de contexto. No obstante, esta diversificación —modelos de IA en GPUs, agentes en CPUs y descarga de contexto— comenzará a ejercer una presión creciente sobre las redes de los centros de datos.

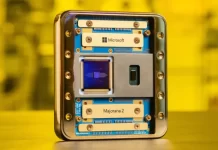

Hardware y competencia en el mercado

Los modelos de tamaño medio están ganando tracción al actuar como coordinadores de agentes en sistemas como OpenClaw, además de fortalecer sus capacidades multimodales. Este fenómeno ha despertado el interés por GPUs de rango medio, como la NVIDIA B40, ideales tanto para estos modelos como para la decodificación en arquitecturas de inferencia desagregadas.

Sin embargo, el informe advierte que el mayor desafío competitivo para cualquier chip de IA nuevo sigue siendo la GPU insignia del año anterior. Los procesadores más antiguos están reteniendo su valor y permaneciendo en servicio, ya que siguen ofreciendo una opción rentable para la inferencia de modelos pequeños y medianos.

Fuente: Omdia