Google ha dado un nuevo paso en su estrategia de modelos generativos con Nano Banana 2, una versión que combina la velocidad de Gemini Flash con las capacidades avanzadas que antes estaban reservadas para Nano Banana Pro. La compañía presenta este modelo como una respuesta a la necesidad de generar imágenes con mayor rapidez sin perder precisión, algo relevante en un momento en que la creación visual se integra en flujos de trabajo cotidianos, desde la producción de materiales publicitarios hasta la elaboración de diagramas o infografías. Según la información publicada, Nano Banana 2 reúne en un solo modelo la agilidad para iterar en tiempo real y un conocimiento del mundo más amplio, apoyado en datos actualizados y en la capacidad de interpretar referencias visuales y textuales con mayor detalle.

La propuesta se apoya en la idea de que la generación de imágenes ya no es solo una herramienta creativa, sino un recurso transversal para tareas que requieren precisión contextual. El modelo puede representar objetos específicos, lugares reales o estilos artísticos con mayor coherencia, y también incorpora mejoras en la generación de texto dentro de las imágenes, un aspecto que suele ser complejo para los modelos generativos. Esta capacidad resulta útil para maquetas de diseño, señalética o materiales que requieren localización lingüística, ya que el sistema puede traducir y adaptar el texto integrado en la imagen. La integración de información procedente de búsquedas web permite que el modelo represente temas concretos con mayor fidelidad, lo que amplía su utilidad en entornos profesionales.

Otro de los elementos destacados es el control creativo. Nano Banana 2 mejora la consistencia de personajes y objetos, algo relevante para quienes trabajan con narrativas visuales o necesitan mantener continuidad entre varias imágenes. El modelo puede preservar la identidad de varios personajes y elementos en un mismo flujo de trabajo, reduciendo variaciones no deseadas entre una imagen y otra. También responde con mayor precisión a instrucciones complejas, lo que facilita ajustar detalles específicos sin necesidad de múltiples iteraciones. La calidad visual se refuerza con mejoras en iluminación, texturas y nitidez, manteniendo tiempos de generación propios de un modelo optimizado para velocidad.

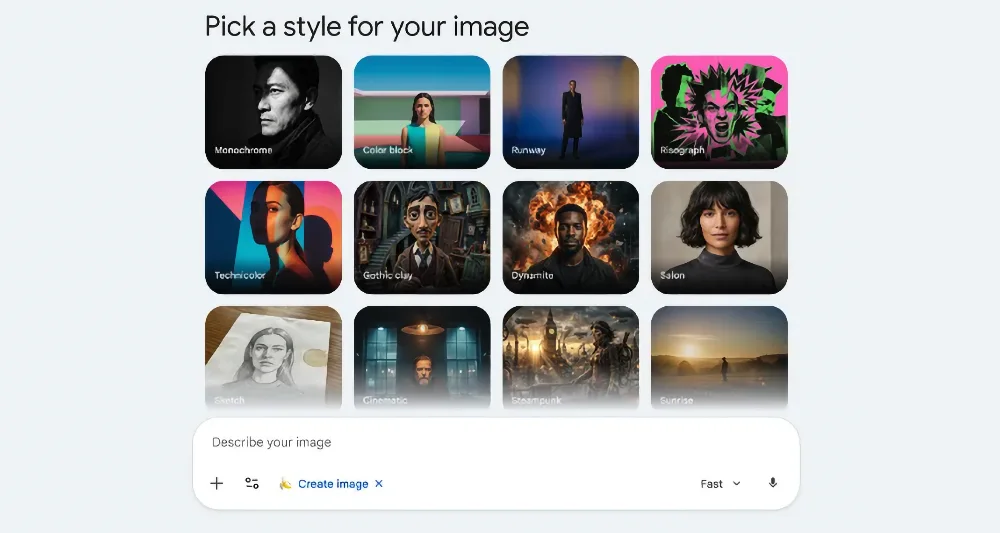

Google está desplegando Nano Banana 2 en distintos productos de su ecosistema. En la aplicación Gemini sustituirá a Nano Banana Pro en los modos Fast, Thinking y Pro, aunque los suscriptores de Google AI Pro y Ultra podrán seguir accediendo a la versión anterior para tareas que requieran máxima precisión. También estará disponible en el modo de búsqueda con IA, en Google Ads para la creación de campañas y en plataformas para desarrolladores como AI Studio, la API de Gemini y Vertex AI en Google Cloud. La compañía ha ampliado además la disponibilidad geográfica y lingüística de estas funciones, lo que refleja su intención de consolidar la generación de imágenes como una herramienta integrada en sus servicios.

El lanzamiento se acompaña de avances en herramientas de procedencia y verificación. Google continúa desarrollando SynthID, una tecnología que marca contenido generado por IA de forma imperceptible, y la combina con credenciales de contenido C2PA, un estándar interoperable que permite verificar cómo se ha producido una imagen. Desde su lanzamiento, la función de verificación de SynthID en la aplicación Gemini ha sido utilizada millones de veces, lo que muestra la creciente preocupación por la autenticidad del contenido digital. La compañía planea incorporar también verificación C2PA en la aplicación, ampliando las opciones para identificar contenido generado por IA.

Nano Banana 2 se presenta así como un modelo orientado a equilibrar velocidad, control y trazabilidad. Su integración en productos de consumo y herramientas profesionales sugiere que Google busca que la generación de imágenes forme parte natural de procesos creativos y operativos, sin exigir conocimientos técnicos avanzados. En un entorno donde la producción visual se acelera y la verificación del contenido se vuelve más relevante, la combinación de capacidades generativas y mecanismos de autenticación apunta a un uso más responsable y contextualizado de la IA en la creación de imágenes.

Fuente: blog de Google | Editado por CDOL