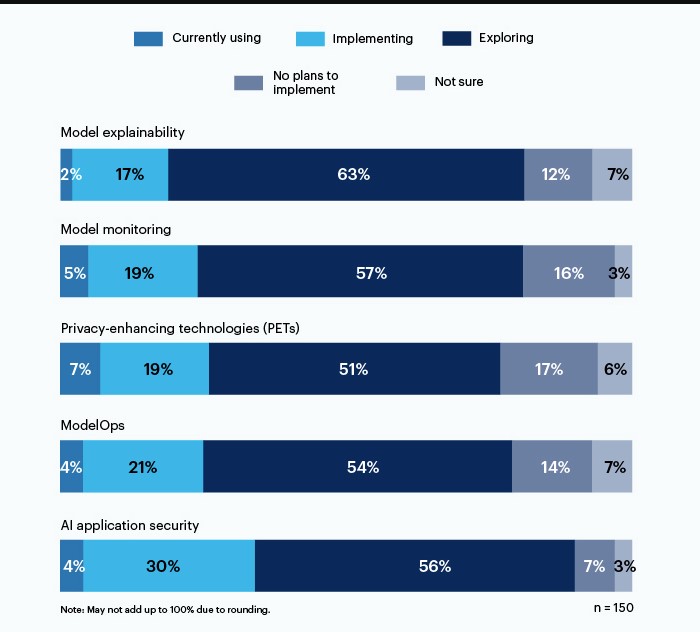

34% de las empresas ya están implementando herramientas de seguridad de aplicaciones de inteligencia artificial (IA) para mitigar los riesgos que conlleva la IA generativa (GenAI), según una nueva encuesta de Gartner, Inc. Más de la mitad (56%) de los encuestados afirmaron que también están explorando este tipo de soluciones.

La encuesta de Gartner Peer Community se llevó a cabo del 1 al 7 de abril entre 150 líderes de TI y seguridad de la información de organizaciones en las que la GenAI o los modelos fundacionales están en uso, en planes de uso o en fase de exploración.

El 26% de los encuestados afirmaron estar implantando o utilizando actualmente tecnologías de mejora de la privacidad (PET), ModelOps (25%) o supervisión de modelos (24%) (véase la figura 1).

Figura 1: Organizaciones que utilizan o tienen previsto utilizar herramientas para abordar los riesgos relacionados con la IA generativa (Porcentaje de encuestados)

Fuente: Gartner Peer Community (septiembre de 2023)

«Los líderes de TI y de gestión de riesgos y seguridad deben, además de implementar herramientas de seguridad, considerar el apoyo a una estrategia en toda la empresa para AI TRiSM (gestión de confianza, riesgo y seguridad)», dijo Avivah Litan, Distinguida VP Analista de Gartner. «AI TRiSM gestiona los flujos de datos y procesos entre los usuarios y las empresas que alojan modelos de base de IA generativa, y debe ser un esfuerzo continuo, no un ejercicio puntual para proteger continuamente a una organización. «TI es el responsable último de la seguridad de GenAI.

Mientras que el 93% de los líderes de TI y seguridad encuestados afirmaron estar al menos algo implicados en los esfuerzos de gestión de riesgos y seguridad de la GenAI de su organización, sólo el 24% afirmaron asumir esta responsabilidad.

Entre los encuestados que no asumen la responsabilidad de la seguridad y/o la gestión de riesgos de la GenAI, el 44% afirmó que la responsabilidad última de la seguridad de la GenAI recaía en TI. Para el 20% de los encuestados, la responsabilidad recaía en los departamentos de gobierno, riesgo y cumplimiento de su organización.

Los riesgos más importantes

Los riesgos asociados a GenAI son significativos, continuos y evolucionarán constantemente. Los encuestados indicaron que los resultados no deseados y el código inseguro se encuentran entre sus principales riesgos al utilizar GenAI:

*Al 57 % de los encuestados le preocupa la filtración de secretos en el código generado por la IA.

*Al 58% de los encuestados le preocupan los resultados incorrectos o sesgados.

«Las organizaciones que no gestionen el riesgo de la IA serán testigos de cómo sus modelos no funcionan como se pretende y, en el peor de los casos, pueden causar daños humanos o materiales», afirma Litan. «Esto dará lugar a fallos de seguridad, pérdidas financieras y de reputación, y daños a las personas por resultados incorrectos, manipulados, poco éticos o sesgados». El mal funcionamiento de la IA también puede hacer que las organizaciones tomen malas decisiones empresariales.»

Fuente: Gartner