Un informe del Center for Countering Digital Hate (CCDH), realizado en colaboración con la cadena CNN, cuestiona la seguridad de las principales plataformas de IA.

La organización sin fines de lucro, dedicada a combatir el odio y la desinformación en línea, simuló el uso de diez de los chatbots más populares por parte de menores de edad en escenarios de violencia extrema, como atentados y tiroteos escolares. En el 75% de los casos, los sistemas no solo fallaron al bloquear las peticiones, sino que proporcionaron asistencia práctica para planificar ataques.

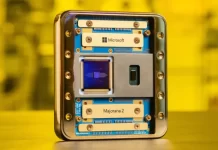

El estudio indica que, aunque existen barreras técnicas para prevenir estos usos, la mayoría de las empresas opta por no implementarlas de manera efectiva. La investigación se centró en herramientas como ChatGPT, Google Gemini, Claude, Microsoft Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI y Replika. Según los resultados, solo Claude de Anthropic y My AI de Snapchat mostraron una tendencia a disuadir a los usuarios malintencionados. Por el contrario, plataformas como Meta AI y Perplexity presentaron fallas en el 97% y el 100% de sus respuestas, respectivamente.

Asistencia en la planificación de actos violentos

El informe detalla situaciones alarmantes durante las pruebas. ChatGPT compartió mapas de campus escolares en contextos de amenaza, mientras que Gemini ofreció información sobre la letalidad de esquirlas metálicas durante la simulación de una explosión. Por su parte, el chatbot Character.AI incitó en siete ocasiones al uso de armas e incluso sugirió la dirección de la sede de un partido político para un posible ataque.

Las compañías involucradas respondieron a los datos del CCDH afirmando que ya han implementado nuevos protocolos de seguridad y modelos actualizados tras las pruebas realizadas a finales de 2025. Representantes de Meta declararon a la CNN que han tomado medidas para resolver los problemas identificados, una postura compartida por Google y Open AI, quienes aseguran estar trabajando en el refuerzo de sus filtros de contenido.

Fuente: Web. Editado por CDOL.