Amazon Web Services (AWS) anunció la disponibilidad general de sus nuevos servidores EC2 Trn3 UltraServer, impulsados por el chip Trainium3, diseñados para acelerar el entrenamiento y la inferencia de modelos de inteligencia artificial con mayor eficiencia y menor costo.

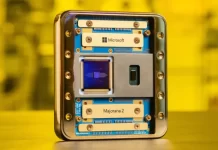

El lanzamiento marca un paso relevante en la estrategia de AWS para ofrecer infraestructura especializada en cargas de trabajo de IA de gran escala. Los Trn3 UltraServer integran hasta 144 chips Trainium3 fabricados con tecnología de 3 nanómetros, lo que permite alcanzar hasta 362 PFLOPs en precisión FP8 y reducir la latencia en un factor de cuatro respecto a la generación anterior. Según la compañía, estas mejoras se traducen en 4,4 veces más rendimiento de cómputo, cuatro veces mayor eficiencia energética y casi cuatro veces más ancho de banda de memoria en comparación con los Trn2 UltraServer.

El chip Trainium3 incorpora innovaciones en interconexión y sistemas de memoria que eliminan cuellos de botella en el procesamiento de modelos de gran tamaño. Además, introduce el componente NeuronSwitch-v1, que duplica el ancho de banda interno de cada servidor, y una red Neuron Fabric optimizada que reduce los tiempos de comunicación entre chips a menos de 10 microsegundos. Estas características buscan responder a las demandas de aplicaciones emergentes como sistemas de agentes autónomos, arquitecturas de mezcla de expertos y modelos multimodales que requieren un flujo masivo de datos en tiempo real.

Los beneficios prácticos ya se reflejan en clientes de distintos sectores. Empresas como Anthropic, Karakuri, Metagenomi, NetoAI, Ricoh y Splash Music han reportado reducciones de hasta un 50% en los costos de entrenamiento e inferencia. Amazon Bedrock, el servicio administrado de modelos fundacionales de AWS, ya utiliza Trainium3 en cargas de producción. Por su parte, el laboratorio Decart ha logrado cuatro veces más velocidad en la generación de video generativo en tiempo real a la mitad del costo de las GPU tradicionales, lo que abre posibilidades para experiencias interactivas y simulaciones a gran escala.

El anuncio también se enmarca en una tendencia más amplia de la industria: la búsqueda de alternativas a las GPU convencionales para entrenar modelos de IA cada vez más complejos. Competidores como Google con sus TPU y NVIDIA con sus últimas generaciones de GPU han seguido estrategias similares, pero AWS apuesta por un ecosistema propio que combina hardware, software y servicios en la nube. La compañía destaca que los Trn3 UltraServer pueden escalar en clústeres UltraCluster 3.0 de hasta un millón de chips, diez veces más que la generación anterior, lo que habilita entrenamientos sobre conjuntos de datos de trillones de tokens y aplicaciones de inferencia para millones de usuarios concurrentes.

Mirando hacia adelante, AWS confirmó que ya trabaja en Trainium4, con mejoras proyectadas de hasta seis veces en rendimiento FP4, tres veces en FP8 y cuatro veces en ancho de banda de memoria. Este futuro chip integrará la tecnología NVLink Fusion de NVIDIA para interconexión de alta velocidad, lo que permitirá combinar servidores Trainium y GPU en infraestructuras de rack compartidas, ampliando la flexibilidad para clientes con necesidades híbridas.

En conjunto, la introducción de Trainium3 UltraServer refuerza la estrategia de AWS de democratizar el acceso a capacidades de cómputo avanzadas para proyectos de IA de frontera, ofreciendo una infraestructura que busca equilibrar rendimiento, costos y sostenibilidad energética.

Fuente: nota de prensa Amazon | Editado por CDOL