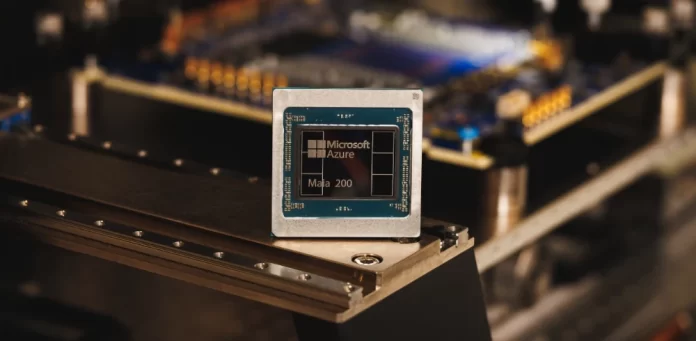

Microsoft presentó Maia 200, un acelerador de inferencia diseñado para mejorar la eficiencia y el costo operativo de los modelos de inteligencia artificial a gran escala. La compañía lo describe como un componente clave dentro de su infraestructura heterogénea de IA, orientado a sostener la demanda creciente de generación de tokens y ejecución de modelos avanzados.

El chip está fabricado con el proceso de 3 nanómetros de TSMC e integra más de 140.000 millones de transistores. Su arquitectura se centra en cálculos de baja precisión, un enfoque que se ha consolidado en la industria para equilibrar rendimiento y eficiencia energética en modelos de gran tamaño. Maia 200 ofrece más de 10 petaFLOPS en precisión FP4 y más de 5 petaFLOPS en FP8 dentro de un sobre térmico de 750 W, cifras que lo posicionan entre los aceleradores más potentes orientados a inferencia disponibles en la nube.

Un rediseño del subsistema de memoria para aumentar el rendimiento

Uno de los elementos centrales del diseño es su sistema de memoria, que combina 216 GB de HBM3e con un ancho de banda de 7 TB/s y 272 MB de SRAM en chip. Este enfoque busca reducir los cuellos de botella habituales en la alimentación de datos hacia los núcleos de cómputo, un desafío recurrente en la ejecución de modelos de lenguaje de gran tamaño. La arquitectura incorpora motores de movimiento de datos y un tejido de interconexión especializado para mantener un flujo constante de información, lo que se traduce en mayor rendimiento por dólar en comparación con generaciones previas de hardware de Microsoft.

Infraestructura escalable basada en Ethernet estándar

A nivel de sistema, Maia 200 introduce un diseño de red de dos niveles construido sobre Ethernet estándar. Microsoft optó por evitar tejidos propietarios, apoyándose en una capa de transporte personalizada y una NIC integrada para mejorar la confiabilidad y reducir costos. Cada acelerador expone 2,8 TB/s de ancho de banda bidireccional dedicado para operaciones de escala vertical, y la arquitectura permite agrupar hasta 6.144 aceleradores en clústeres de inferencia densos.

Este enfoque unificado de red facilita la programación y permite escalar cargas de trabajo entre nodos, racks y clústeres sin cambios significativos en el modelo de comunicación. Además, contribuye a disminuir la capacidad ociosa y a mantener un rendimiento consistente en entornos de nube.

Integración con Azure y validación anticipada

Microsoft destaca que el desarrollo de Maia 200 se apoyó en un entorno de validación previo al silicio, capaz de modelar patrones de cómputo y comunicación de modelos de IA con alta fidelidad. Esta estrategia permitió optimizar el chip, la red y el software de manera conjunta antes de disponer de las primeras unidades físicas.

La integración nativa con el plano de control de Azure proporciona capacidades de seguridad, telemetría y diagnóstico tanto a nivel de chip como de rack. La compañía señala que los primeros modelos comenzaron a ejecutarse en Maia 200 pocos días después de recibir los primeros chips empaquetados, y que el tiempo entre la llegada del silicio y su despliegue en centros de datos se redujo a menos de la mitad respecto a programas anteriores.

Casos de uso y despliegue inicial

Maia 200 está destinado a servir múltiples modelos, incluidos los GPT‑5.2 de OpenAI, y a impulsar servicios como Microsoft 365 Copilot y Microsoft Foundry. El equipo de Superinteligencia de Microsoft lo utilizará para generación de datos sintéticos y aprendizaje por refuerzo, dos áreas que requieren un flujo constante de datos específicos y filtrados para entrenar modelos de nueva generación.

El acelerador ya está desplegado en la región US Central, cerca de Des Moines (Iowa), y su expansión continuará en US West 3, en Phoenix (Arizona), antes de llegar a otras regiones.

Un SDK para desarrolladores y una hoja de ruta multigeneracional

Microsoft abrió el acceso preliminar al SDK de Maia 200, que incluye integración con PyTorch, un compilador Triton, bibliotecas de kernels optimizados y un lenguaje de programación de bajo nivel. También incorpora un simulador y herramientas de cálculo de costos para facilitar la optimización temprana del código.

La compañía anticipa que Maia será una familia multigeneracional de aceleradores, con nuevas versiones ya en desarrollo. El objetivo es sostener la evolución de los modelos de IA y mejorar de forma continua la eficiencia por dólar y por vatio en cargas de trabajo críticas.

Fuente: Nota de prensa Microsoft | Editado por CDOL