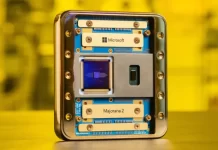

Meta ha dado un nuevo impulso a su estrategia de hardware propio con la ampliación de su familia de chips MTIA (Meta Training and Inference Accelerator), una línea de silicio diseñada internamente para soportar sus cargas de trabajo de inteligencia artificial. La compañía confirmó que está desarrollando y desplegando cuatro nuevas generaciones de estos procesadores en un plazo de dos años, un ritmo significativamente más rápido que los ciclos habituales de la industria. El objetivo es reforzar la capacidad de la empresa para gestionar sistemas de recomendación, clasificación de contenido y modelos generativos a gran escala, al tiempo que reduce la dependencia de proveedores externos.

La iniciativa forma parte de una visión más amplia: construir una infraestructura capaz de servir modelos de IA a miles de millones de personas, con un enfoque en eficiencia, escalabilidad y control sobre la cadena tecnológica. Desde 2023, cuando Meta presentó la primera versión de MTIA, la compañía ha ido consolidando un enfoque de desarrollo iterativo que combina diseño modular, integración con estándares abiertos y un énfasis en la inferencia como prioridad.

Un enfoque propio para cargas de IA a escala masiva

Meta despliega actualmente cientos de miles de chips MTIA en sus centros de datos, principalmente para tareas de inferencia relacionadas con contenido orgánico y publicidad. Estos procesadores están optimizados para los patrones de uso específicos de la compañía, lo que permite obtener una mayor eficiencia energética y de cómputo frente a chips de propósito general. La empresa sostiene que esta especialización reduce costes y facilita la adopción de nuevas generaciones sin rediseñar la infraestructura física.

La hoja de ruta anunciada incluye cuatro nuevos modelos: MTIA 300, ya en producción para cargas de ranking y recomendaciones, y MTIA 400, 450 y 500, orientados a soportar inferencia de modelos generativos y, en menor medida, entrenamiento. La modularidad del diseño permite que estos chips se integren en los racks existentes, acelerando su despliegue en los centros de datos.

Meta ha adoptado un enfoque inverso al de la industria: mientras muchos fabricantes diseñan chips pensando primero en el entrenamiento de modelos de gran escala, la compañía prioriza la inferencia, que considera el componente más crítico para servir aplicaciones de IA a miles de millones de usuarios. Según la empresa, esta estrategia permite ajustar mejor el rendimiento a las necesidades reales de sus plataformas.

Integración con estándares abiertos y un portafolio diversificado

Los chips MTIA se apoyan en ecosistemas de software ampliamente utilizados, como PyTorch, Triton y vLLM, y en estándares de hardware del Open Compute Project. Esta alineación facilita su integración en entornos existentes y reduce las barreras para su adopción interna. Además, Meta mantiene un enfoque de portafolio que combina silicio propio con procesadores de terceros, incluidos los de fabricantes líderes en GPU y aceleradores especializados.

La compañía reconoce que no existe un único chip capaz de cubrir todas las necesidades de sus cargas de trabajo, que abarcan desde modelos de recomendación hasta sistemas generativos y agentes de IA. Por ello, la estrategia combina hardware interno con soluciones externas, buscando flexibilidad y capacidad de adaptación a nuevas técnicas de IA.

Escalar la IA para miles de millones de usuarios

En paralelo a la expansión de MTIA, Meta ha detallado su visión para construir una infraestructura capaz de servir modelos de IA a escala planetaria. La empresa destaca que la demanda de inferencia crece de forma acelerada, impulsada por la adopción de modelos generativos, asistentes personales y sistemas de recomendación más complejos. Para sostener este crecimiento, Meta está ampliando su capacidad de cómputo, optimizando su red de centros de datos y reforzando su apuesta por hardware especializado.

La compañía también subraya que su estrategia de silicio personalizado no busca reemplazar completamente a los proveedores tradicionales, sino complementar sus capacidades. En este sentido, Meta continúa colaborando con fabricantes de GPU y otros aceleradores, integrando sus chips en un ecosistema híbrido que combina rendimiento, eficiencia y disponibilidad.

Un movimiento alineado con la evolución del mercado

El anuncio se produce en un contexto de creciente interés por parte de grandes empresas tecnológicas en desarrollar hardware propio para IA. Compañías como Google, Amazon y Microsoft han acelerado sus inversiones en chips personalizados para reducir costes, mejorar la eficiencia y adaptar sus infraestructuras a modelos cada vez más complejos. En este escenario, la estrategia de Meta refuerza su posición en un mercado donde la capacidad de escalar la inferencia se ha convertido en un factor competitivo clave.

Con la llegada de las nuevas generaciones de MTIA, Meta busca consolidar una infraestructura que pueda sostener el crecimiento de sus aplicaciones de IA, desde sistemas de recomendación hasta modelos generativos y agentes autónomos. La compañía considera que esta evolución es esencial para avanzar hacia su objetivo de ofrecer experiencias de IA más personalizadas y accesibles para miles de millones de personas.

Fuente: nota de prensa Meta | Editado por CDOL